京东云语音语义领域8篇论文被国际顶会发表(2)

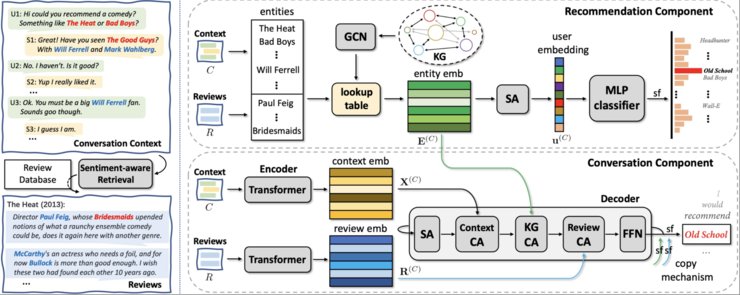

论文标题:RevCore: Review-Augmented Conversational Recommendation

论文链接: of ACL 2021

Motivation: 对话推荐系统(Conversational Recommender System)是基于自然语言的多轮对话理解用户的需求和偏好,并根据当前动态的需求和偏好推荐商品和服务。对话推荐系统中长期存在2个挑战。1)对话中信息量较少导致的推荐准确度较低的问题;?2)数据收集过程缺乏专业性导致生成的对话回复信息量较少的问题。

Solution: 本论文提出使用非结构化的评论作为外部知识缓解对话推荐系统中由于信息量较少而存在的推荐准确度低且回复话术信息量不足的问题。该方法首先突破了非结构性文本(评论)与结构化知识(知识图谱)在对话推荐系统的技术性融合的问题。其次,通过在对话推荐过程中检索出情感一致的评论,进一步提高对用户推荐的契合度。本论文提出的RevCore系统框架图如下图。

Experimental Result: 本方法在保证外部文本与原始数据逻辑一致的前提下,在对话质量和推荐质量上均有较大提升。情感一致的用户评论的引入,首先提高了推荐系统的准确度。此外,由于更加丰富的实体信息以及适当的建模方式提高了对话回复的多样性和丰富度。该框架可较好的应用在工业界的对话推荐系统中,包括智能客服、智能家居、智能对话机器人等。该框架还具有较强的可移植性,RevCore在电影对话推荐领域获得的提升,将给予其他各个行业启发,利用外部评论数据创造更好的对话推荐引擎,提供更好的行业服务。

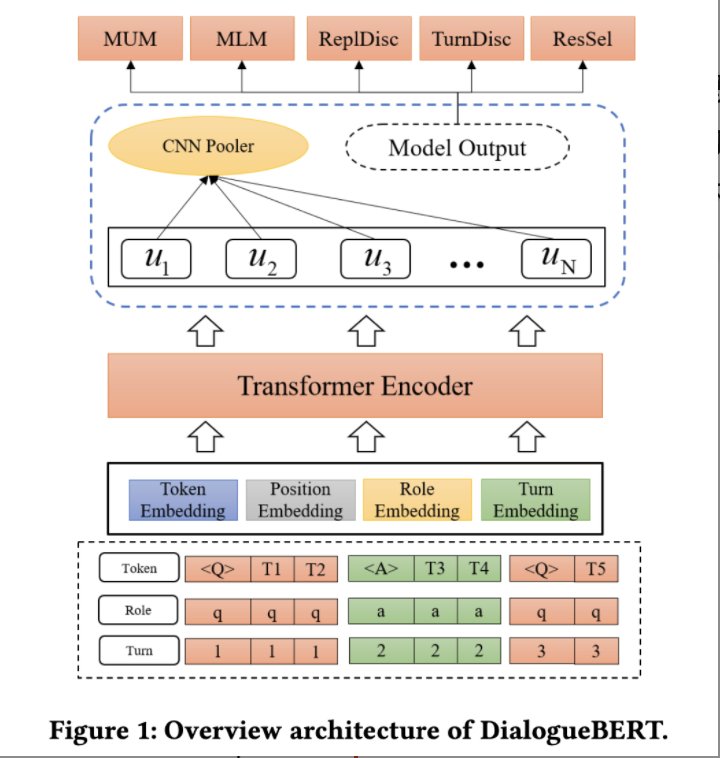

论文标题:DialogueBERT: A Self-Supervised Learning based Dialogue Pre-training Encoder

论文链接: 2021

Motivation:对话文本由于其特殊的角色信息和层次化结构,普通的文本编码器在对话任务的下游任务中往往不能发挥最好的效果。在这篇文章中,受到自监督学习在NLP任务中广泛应用的启发,我们提出了基于自监督学习、面向对话的预训练模型DialogueBERT。

Solution:这篇论文提出了五个面向对话的自监督预训练任务,包括消息掩码建模、单词掩码建模、消息替换建模、消息顺序交换建模、答复对比建模,基于Transformer模型架构,利用海量对话数据进行预训练,抽取其中的单词、对话轮次、对话角色信息作为输入,学习对话文本的上文结构信息和对话场景语义表示。

Experimental Result:实验证明我们的模型相比其他面向对话的预训练模型,可以较好的改进意图识别、实体识别以及情绪识别等下游对话理解任务的表现。DilaogueBERT直接利用海量无监督对话数据进行自监督学习,证明了基于对话语料的预训练的可行性。相比传统的基于监督学习的编码器和基于通用自然语言模型的编码器,DialogueBERT准确率更高,能够获得更加鲁棒的对话编码效果。本文还分析了多种针对自监督学习的任务特点,对于未来的对话自监督编码研究具有一定借鉴意义。

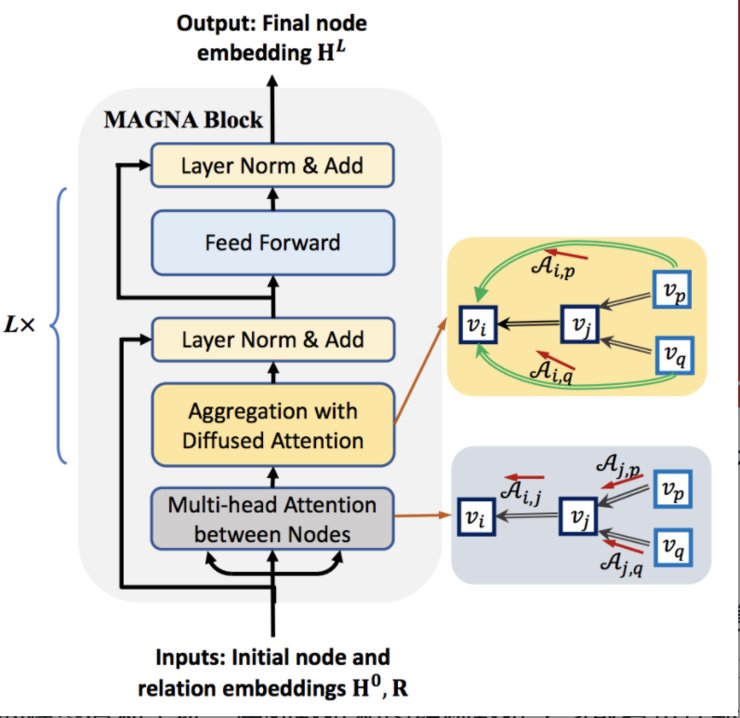

论文标题:Multi-hop Attention Graph Neural Networks

论文链接: 2021

Motivation: 目前基于注意力机制的图神经网络中的Attention仅局限于直接邻居,因此每一层的感受域只局限在单跳结构中,学习多跳结构信息需叠加更多的层数,然而更多层数通常会带来过平滑问题(Over-smoothing Problem)。同时这些Attention的计算只与节点表示本身有关,并没有考虑到图结构的上下文信息,而将多跳近邻结构化信息考虑到图神经网络的注意力计算很少被研究。

Solution: 本论文提出一种基于多跳注意力机制的图神经网络模型(MAGNA),包括图注意力扩散模块, 深层Feed Forward聚合模块,Layer Normalization以及残差链接,基于图扩散(Graph Diffusion)的注意力计算,能够在单层图神经网络中具有多跳结构的感受域。同时给出了基于谱特征分析,证明多跳diffusion attention相比单跳attention具有更好的图结构学习能力。

Experimental Result:本论文提出的模型,在半监督图节点分类问题以及知识图谱补全任务上均取得SOTA的性能,同时能够解决深层图神经网络通常出现的过平滑问题。

Impact: 基于图扩散注意力计算是将稀疏图信息和自注意力计算统一到一个模型中的关键步骤,在避免过拟合的同时提高了模型性能,并且只引入了常数因子的训练时间开销。自注意力机制在序列(如NLP)数据上取得巨大成功,而基于图扩散的注意力机制在计算任何两点之间的注意力的同时兼顾到结构信息。因此,本论文提出的模型有利于统一序列数据和图结构数据学习或者设计新的算法在考虑结构化信息的同时进行序列分析(如将语法树信息融合进文本情感分析/利用Diffusion Attention方法实现稀疏化Transformer)。

文章来源:《国际研究参考》 网址: http://www.gjyjck.cn/zonghexinwen/2021/1017/1186.html